Gobernanza de agentes de IA: una guía práctica sobre riesgo, confianza y cumplimiento

ALCANZA LA EVOLUCIÓN DIGITAL DE TU EMPRESA,

MÁS ALLÁ DE LAS PLATAFORMAS

Los tres pilares de una gobernanza eficaz de los agentes de IA

La gobernanza de agentes de IA se sostiene sobre tres pilares interdependientes. No son secuenciales ni opcionales: no es posible generar confianza sin gestionar el riesgo, ni demostrar cumplimiento sin ambos. Las organizaciones que los abordan por separado suelen enfrentarse a brechas cuando reguladores o auditores exigen evidencia integral.

- Gestión de riesgos de IA: se centra en prevenir daños materiales, detectar desviaciones en el comportamiento de los agentes y mitigar riesgos como fallos en cascada, desalineación de objetivos y comportamientos emergentes no previstos.

- Confianza e IA responsable: aborda la dimensión humana. Clientes, empleados, socios y reguladores necesitan entender cuándo los agentes toman decisiones, por qué lo hacen y cuándo interviene la supervisión humana. Sin confianza, el uso de agentes se limita a escenarios de bajo riesgo.

- Cumplimiento normativo: refleja el entorno legal en el que operan las organizaciones. Normativas como la Ley de IA de la UE, junto con regulaciones sectoriales y estatales, exigen auditabilidad, trazabilidad y controles demostrables como evidencia de operación responsable.

En conjunto, estos pilares determinan si los sistemas basados en agentes pueden ser confiables, explicables y defendibles ante situaciones críticas.

¿Por qué esta base es clave para escalar la IA con agentes?

Construir correctamente esta base define todo lo que sigue: cómo se evalúan las plataformas, en qué infraestructura se invierte, qué nivel de observabilidad se requiere y con qué claridad se pueden explicar los sistemas a stakeholders escépticos.

Las organizaciones que omiten este enfoque suelen desarrollar una gobernanza sólida en apariencia, pero débil en ejecución: políticas que no se aplican, controles que no previenen incidentes reales y documentación incapaz de responder cuando surgen problemas.

La IA con agentes representa una nueva forma de construir sistemas. Por ello, la gobernanza debe evolucionar en la misma dirección: no más rígida, sino más integrada en el diseño y operación.

¿Por qué la gobernanza de agentes de IA es innegociable?

La gobernanza ya no es una opción estratégica, sino un requisito operativo. La presión regulatoria, los riesgos legales y la complejidad técnica han convertido la gobernanza de IA en una condición indispensable para escalar agentes en entornos productivos.

Regulación: la gobernanza como mandato legal

La Ley de IA de la Unión Europea ya está en vigor y clasifica muchos sistemas basados en agentes como de alto riesgo, especialmente en áreas como crédito, contratación o servicios esenciales. Estos casos requieren gestión de riesgos, gobernanza de datos, transparencia y supervisión humana. Las sanciones pueden alcanzar 35 millones de euros o el 7% de los ingresos globales.

En Estados Unidos, la regulación avanza por estados:

- California aborda la discriminación algorítmica.

- Nueva York exige auditorías en sistemas de empleo basados en IA.

- Colorado impone requisitos de protección al consumidor.

Esto implica que las organizaciones operan bajo múltiples marcos regulatorios simultáneamente.

Por ejemplo, un agente de atención al cliente que gestiona reembolsos o un agente de recursos humanos que filtra candidatos pueden clasificarse como sistemas de alto riesgo, ampliando el alcance de cumplimiento más allá de lo esperado.

Responsabilidad: un terreno legal en evolución

Los tribunales ya están definiendo responsabilidades en casos de daños causados por sistemas de IA. Existen demandas por sesgos en decisiones de crédito y contratación con acuerdos millonarios. Además, los sistemas autónomos involucrados en incidentes generan debates complejos sobre responsabilidad legal.

Sin una gobernanza de agentes de IA clara, con decisiones documentadas, trazabilidad y mecanismos de supervisión, las organizaciones quedan expuestas a riesgos legales difíciles de defender.

La pregunta ya no es si se necesitará gobernanza, sino si se implementará de forma preventiva o reactiva.

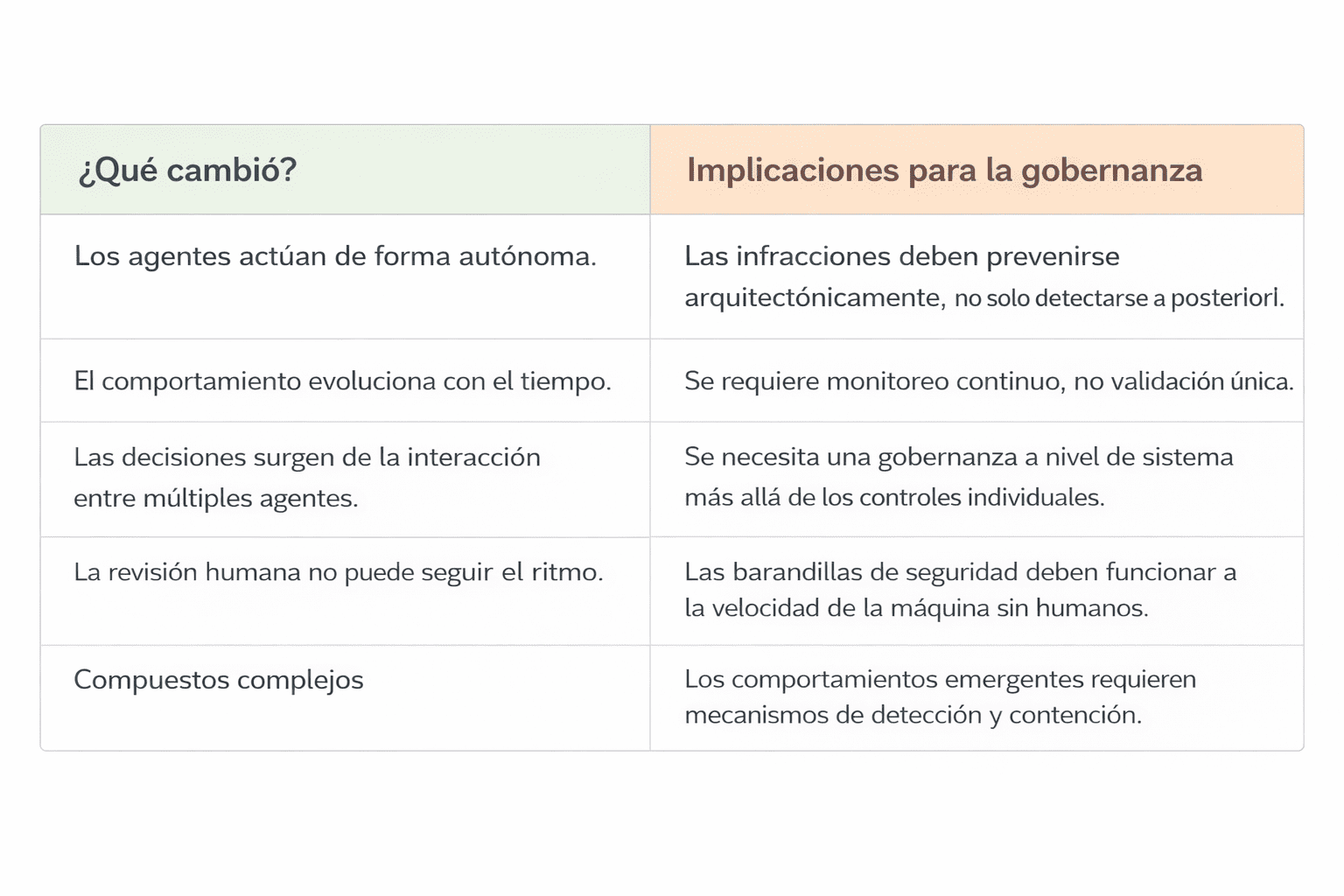

Realidad técnica: la necesidad de gobernanza continua

Los agentes de IA no son sistemas estáticos. Son sistemas probabilísticos que evolucionan con el entorno, los datos y las interacciones. Un comportamiento aceptable en el momento del despliegue puede degradarse o generar efectos no previstos al interactuar con otros agentes.

Sin monitorización continua, análisis de comportamiento y capacidad de intervención en tiempo real, las organizaciones operan sin visibilidad real.

La gobernanza en entornos de IA autónoma debe ser continua por diseño, no puntual.

El argumento empresarial: la gobernanza acelera la adopción

Las organizaciones con marcos maduros de gobernanza implementan agentes de IA más rápido, no más lento.

¿Por qué? Porque eliminan la incertidumbre organizacional. Cuando existen políticas claras, controles validados y riesgos gestionados, los procesos de aprobación se agilizan.

El primer agente establece la base. Los siguientes heredan ese modelo, reduciendo tiempos de implementación de meses a semanas.

Las organizaciones que no logran escalar no están sobrerreguladas, están bloqueadas por la falta de claridad sobre qué es seguro, qué está permitido y qué riesgos no pueden explicar.

La gobernanza no es un obstáculo para la adopción de la IA con agentes. Es lo que permite una escalabilidad sostenible y confiable.

Controles de sesgo y equidad en agentes de IA

El sesgo en los sistemas de gobernanza de agentes de IA puede surgir incluso después del despliegue, impulsado por ciclos de retroalimentación y cambios en los datos. Por ello, una gobernanza efectiva no se limita a evaluaciones iniciales, sino que incorpora monitorización continua, métricas claras de equidad y procesos definidos de corrección.

La clave no está solo en detectar el sesgo, sino en contar con mecanismos accionables cuando este aparece.

Flujo de corrección ante sesgos detectados:

- Contención: reducir inmediatamente la autonomía del agente e incorporar revisión humana.

- Evaluación: dimensionar el impacto (usuarios o grupos afectados).

- Causa raíz: identificar el origen (deriva de datos, bucles de retroalimentación o fallos del modelo).

- Corrección: ajustar modelos, políticas o datos.

- Comunicación: informar a los afectados y aplicar medidas correctivas.

¿Cómo prevenir la inexactitud y la desinformación en agentes de IA?

Las alucinaciones no son solo limitaciones técnicas, sino fallos de gobernanza. En escenarios críticos, la simple fundamentación no es suficiente.

Las prácticas clave incluyen:

- Validación multisource: corroborar información con múltiples fuentes.

- Umbrales de confianza: ejecutar acciones solo cuando se supera un nivel definido (ej. 95%).

- Revisión humana: intervención obligatoria en decisiones de alto impacto.

- Fallback determinista: uso de lógica basada en reglas en procesos críticos.

Las plataformas robustas aseguran que los agentes operen con fuentes aprobadas, validen afirmaciones y apliquen controles adicionales en situaciones de riesgo.

Orquestación y control en entornos multiagente

Cuando múltiples agentes interactúan, la gobernanza debe escalar al nivel del sistema completo.

Esto implica:

- Reglas claras de comunicación entre agentes.

- Monitorización del comportamiento colectivo.

- Mecanismos de contención como interruptores automáticos y aislamiento de fallos.

Supervisión humana y control de emergencia

La autonomía genera eficiencia, pero la gobernanza requiere capacidad de intervención.

Las plataformas maduras permiten:

- Niveles de autonomía progresivos según el riesgo.

- Controles de emergencia como paradas inmediatas y anulaciones.

- Protocolos de escalamiento definidos.

¿Cómo demostrar cumplimiento en sistemas de agentes de IA?

La gobernanza de IA debe generar evidencia automática capaz de resistir auditorías y revisiones regulatorias.

Entre los elementos clave:

- Inventario de agentes y sus funciones.

- Registros completos de decisiones y su trazabilidad.

- Historial de aplicación de políticas y bloqueos.

- Informes de equidad a lo largo del tiempo.

- Registros de incidentes y acciones correctivas.

Además, las plataformas deben alinearse con marcos reconocidos como ISO/IEC 42001 o el AI Risk Management Framework del NIST.

Gobernanza en la práctica: el enfoque de Kore.ai

La gobernanza como base del diseño

A diferencia de otros enfoques, Kore.ai integra la gobernanza de agentes de IA desde la arquitectura. Esto permite construir sistemas donde la seguridad, el cumplimiento y el control no son añadidos posteriores, sino elementos estructurales.

Capacidades clave de gobernanza

- Aplicación por diseño: los límites operativos se imponen técnicamente, no como recomendaciones.

- Protección integral: controles en entrada, proceso, salida y acción.

- Observabilidad nativa: trazabilidad completa de decisiones, alternativas y niveles de confianza.

- Identidad y responsabilidad: cada agente tiene identidad única y acciones atribuibles.

- Gobernanza multiagente: monitorización de interacciones y control de comportamientos emergentes.

- Registros auditables: evidencia inmutable generada automáticamente.

Marco de IA responsable

- Equidad: monitorización continua de impactos.

- Transparencia: explicabilidad multinivel.

- Privacidad: control de acceso y minimización de datos.

- Supervisión humana: intervención adaptativa según riesgo.

Beneficios en entornos reales

- Despliegue más rápido gracias a patrones reutilizables.

- Reducción de costos de cumplimiento mediante automatización.

- Mayor confianza organizacional y regulatoria.

- Preparación continua ante cambios normativos.

Conclusión: de la incertidumbre a la adopción segura

Las preguntas sobre IA con agentes no reflejan duda, sino madurez organizacional. A medida que estos sistemas pasan de la experimentación a la producción, la gobernanza se convierte en un requisito operativo esencial.

Lejos de frenar la innovación, la gobernanza permite escalar con confianza. Define límites claros, acelera aprobaciones, fortalece la trazabilidad y garantiza que los sistemas puedan explicarse y corregirse cuando sea necesario.

En un entorno donde la regulación se intensifica y la complejidad tecnológica crece, implementar agentes sin gobernanza ya no es una opción viable.

Las organizaciones que integran la gobernanza desde el diseño no solo reducen riesgos, sino que avanzan más rápido, con mayor control y con una base sólida para una escalabilidad sostenible en la era de la IA autónoma.